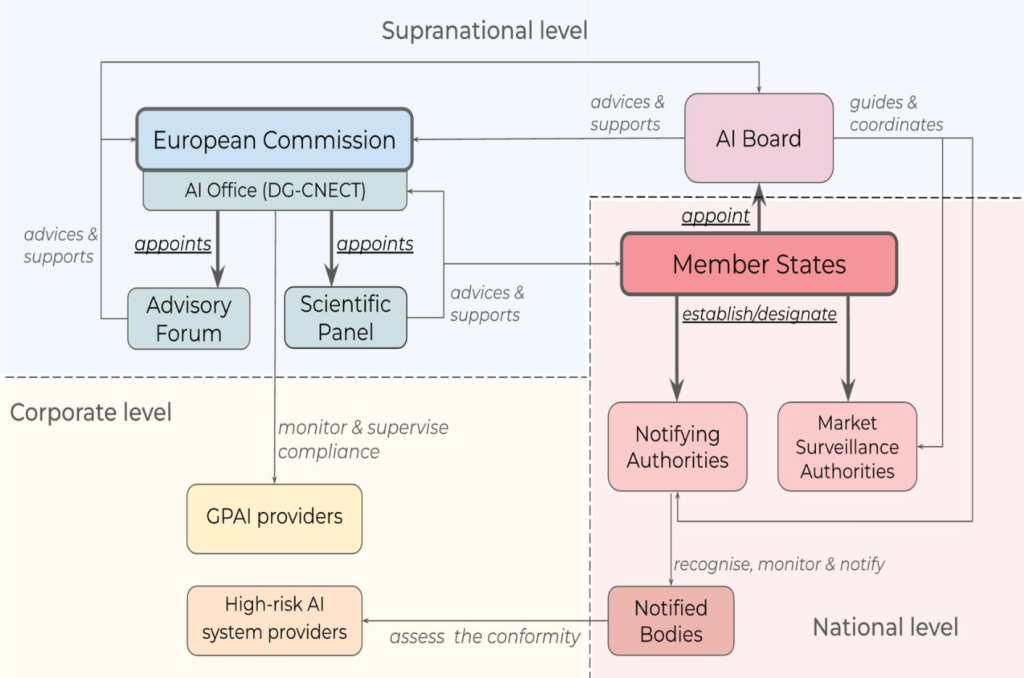

L’AI Act repose sur une architecture institutionnelle à deux niveaux – nationale et européenne – afin d’assurer une application harmonisée de la réglementation dans l’ensemble de l’Union.

1. Au niveau national : autorités de surveillance

Chaque État membre doit désigner des autorités nationales compétentes, chargées de :

surveiller le marché et contrôler les systèmes d’IA,

vérifier les évaluations de conformité,

désigner et superviser les organismes notifiés habilités à réaliser des audits,

appliquer les sanctions en cas de non-conformité.

La désignation de l’autorité nationale compétente est attendue en août 2025. Cette dernière devra collaborer étroitement avec le Bureau de l’IA européen pour garantir la cohérence de la mise en œuvre.

2. Au niveau européen : pilotage centralisé

Au sein de la Commission européenne, le Bureau de l’IA de l’UE (EU AI Office) constitue l'institution maîtresse de la supervision, en particulier pour les modèles d’IA à usage général (GPAI).

Il s’appuie sur deux organes consultatifs :

Le Comité IA (AI Board), qui réunit États membres, société civile, acteurs économiques et académiques, afin d’éclairer les orientations réglementaires et d’intégrer une diversité de points de vue.

Le Panel scientifique consultatif, composé d’experts indépendants, chargé d’identifier les risques systémiques, d’émettre des recommandations techniques et de contribuer à la définition des critères de classification des modèles.

3. Objectif

Ce dispositif vise à garantir une gouvernance rigoureuse, transparente et scientifiquement fondée, afin d’accompagner entreprises et citoyens dans un cadre réglementaire en constante évolution.

Le diagramme suivant illustre la gouvernance de l'IA aux niveaux supranational, national et corporatif (Novelli et al., 2024).